您现在的位置是:首页 >技术交流 >谷歌推出下一代大型语言模型 PaLM 2网站首页技术交流

谷歌推出下一代大型语言模型 PaLM 2

谷歌在 2023 年度 I/O 大会上宣布推出了其下一代大型语言模型 PaLM 2,擅长高级推理任务,包括代码和数学、分类和问答、翻译和多语言能力以及自然语言生成。

谷歌声称 PaLM 2 是一种最先进的语言模型,要优于其之前所有的 LLM,包括 PaLM。目前,PaLM 2 已被用于 Med-PaLM 2 和 Sec-PaLM,并为谷歌的生成人工智能功能和工具(如 Bard 和 PaLM API)提供支持。

推理:PaLM 2 可以将复杂的任务分解为更简单的子任务,并且比以前的 LLM(如 PaLM)更善于理解人类语言的细微差别。例如,PaLM 2 擅长理解谜语和成语,这需要理解词语的歧义和比喻意义,而不是字面意义。

多语言翻译:PaLM 2 在一个包含 100 多种语言的语料库上进行了训练,使得 PaLM 2 擅长多语言任务,包括比以前的模型更细微的措辞。

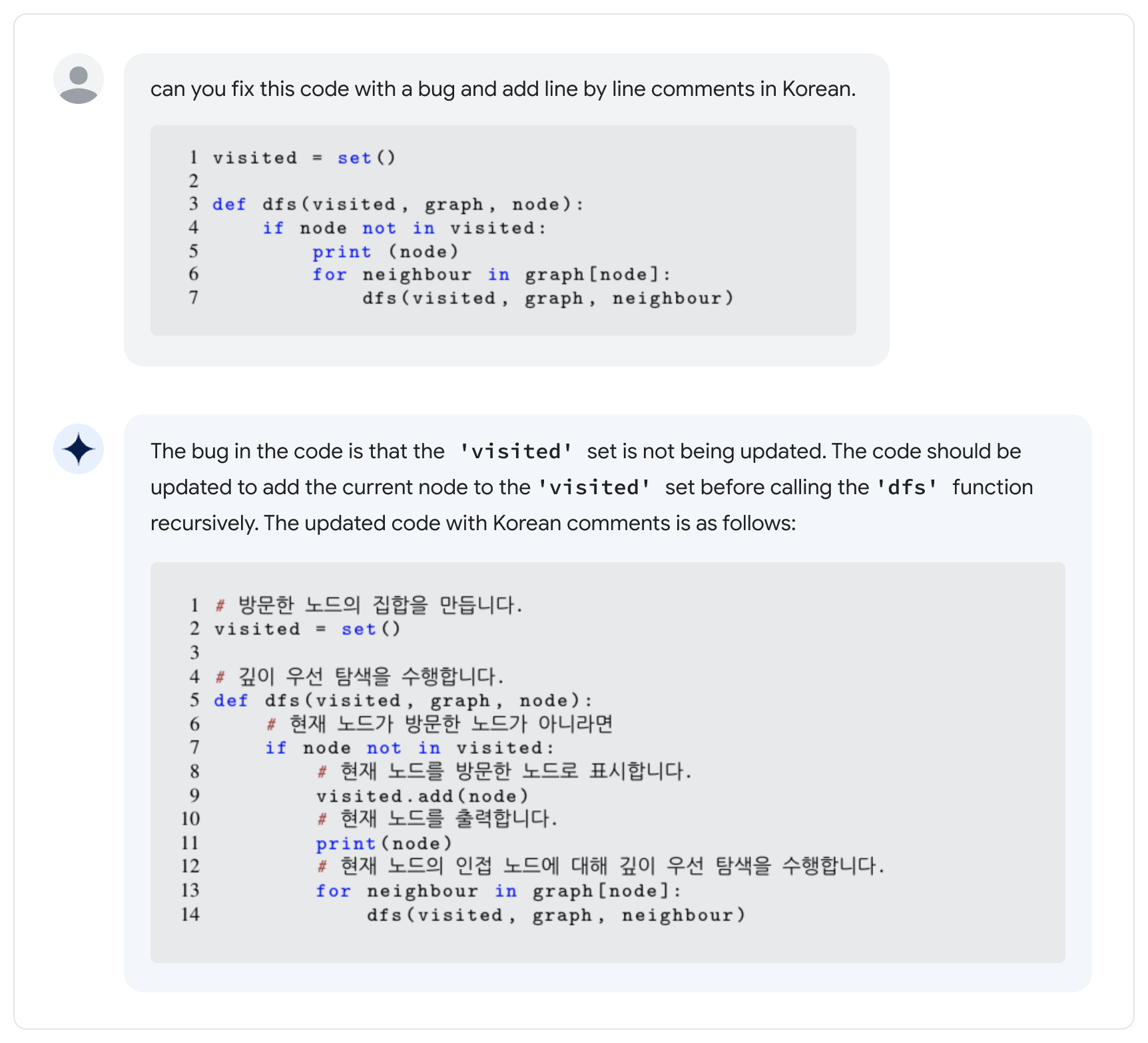

编码:PaLM 2 还可以理解、生成和调试代码,并接受了 20 多种编程语言的预训练。这意味着它擅长使用 Python 和 JavaScript 等流行的编程语言,但也能够使用 Prolog、Fortran 和 Verilog 等语言生成专用代码。将此与其语言功能相结合可以帮助团队跨语言协作。

根据介绍,PaLM 2 因其构建方式而擅长高级推理、翻译和代码生成等任务。它通过统一大型语言模型中三个不同的研究进展,对其前身 PaLM 进行了改进:

- 使用计算最优缩放:计算最优缩放的基本思想是按比例缩放模型大小和训练数据集大小。这种新技术使 PaLM 2 比 PaLM 更小,但效率更高,整体性能更好,包括更快的推理、更少的服务参数和更低的服务成本。

- 改进的数据集混合:以前的 LLM,如 PaLM,使用的预训练数据集主要是英文文本。PaLM 2 通过更多语言和多样化的预训练混合改进了其语料库,其中包括数百种人类和编程语言、数学方程式、科学论文和网页。

- 更新的模型架构和目标: PaLM 2 具有改进的架构,并接受了各种不同任务的训练,所有这些都有助于 PaLM 2 学习语言的不同方面。

谷歌方面指出,一些基准测试表明,PaLM 2 在推理性和多语言性方面的性能要明显优于 PaLM。且 PaLM 2 还改进了 PaLM 和谷歌翻译在葡萄牙语和中文等语言上的翻译能力。

此外,谷歌还在随附的一份 PaLM 2 技术报告论文中透露了,该公司为评估 PaLM 2 在任务上的表现而向 human annotators 支付的报酬 —— 每项判决 0.015 美元。

论文中还阐述了目前 PaLM 2 所存在的不足。在一项旨在了解 PaLM 2 生成有毒文本 (toxic text) 的频率的测试中,合著者使用了一个包含明确的有毒和隐含的或微妙的有害语言混合样本的数据集。当输入明确的有害提示时,PaLM 2 在 30% 以上的时间里产生了有害的反应,对隐含有害的提示的反应则更为甚之(60%)。

在尤其是英语、德语和葡萄牙语等某些语言中,PaLM 2 总体上倾向于更明显地产生有害反应。在一次偏差测试中,该模型几乎有五分之一 (17.9%) 的时间给出了有害的反应,提示提到种族身份 “黑人” 和 “白人” 以及宗教 “犹太教” 和 “伊斯兰教” 时程度更加明显。

“基于 PaLM 2 构建的提示对话系统继续产生有毒的语言伤害,并在这些伤害如何因语言和与身份术语相关的查询而异方面表现出偏见模式。重要的是,这些偏见在不同语言和身份术语之间并不一致,我们看到了偏见...... 尽管这些偏见在对话提示中明确针对。”

研究人员在测试中发现,在 PaLM 2 对提示做出错误回应的所有时间中,有 38.2% 的时间 “强化了有害的社会偏见”。在处理模棱两可的提示时,模型应该承认它不知道答案,但它只有 0.6% 的时间做出了正确回应;更糟糕的是,它更有可能以有偏见的方式做出回应。示例:

更多详情可查看完整报告。

QT多线程的5种用法,通过使用线程解决UI主界面的耗时操作代码,防止界面卡死。...

QT多线程的5种用法,通过使用线程解决UI主界面的耗时操作代码,防止界面卡死。... U8W/U8W-Mini使用与常见问题解决

U8W/U8W-Mini使用与常见问题解决 stm32使用HAL库配置串口中断收发数据(保姆级教程)

stm32使用HAL库配置串口中断收发数据(保姆级教程) 分享几个国内免费的ChatGPT镜像网址(亲测有效)

分享几个国内免费的ChatGPT镜像网址(亲测有效) Allegro16.6差分等长设置及走线总结

Allegro16.6差分等长设置及走线总结