您现在的位置是:首页 >其他 >异常检测经典作:基于teacher-students的无监督异常检测网站首页其他

异常检测经典作:基于teacher-students的无监督异常检测

来源:投稿 作者:Mr.Eraser

编辑:学姐

论文链接:https://arxiv.org/pdf/1911.02357.pdf

贡献

提出了一种基于师生学习的无监督异常检测新框架:来自预训练教师网络的局部描述符用作学生集合的代理标签。模型能够在大型无标签图像数据集上利用所有可用的训练数据进行端到端知识蒸馏训练。

引入了基于学生网络预测方差和回归误差的评分函数,以获得用于分割自然图像中异常区域的密集异常图。描述了如何通过调整学生和教师网络的感受野来扩展到多个尺度上的异常区域分割。

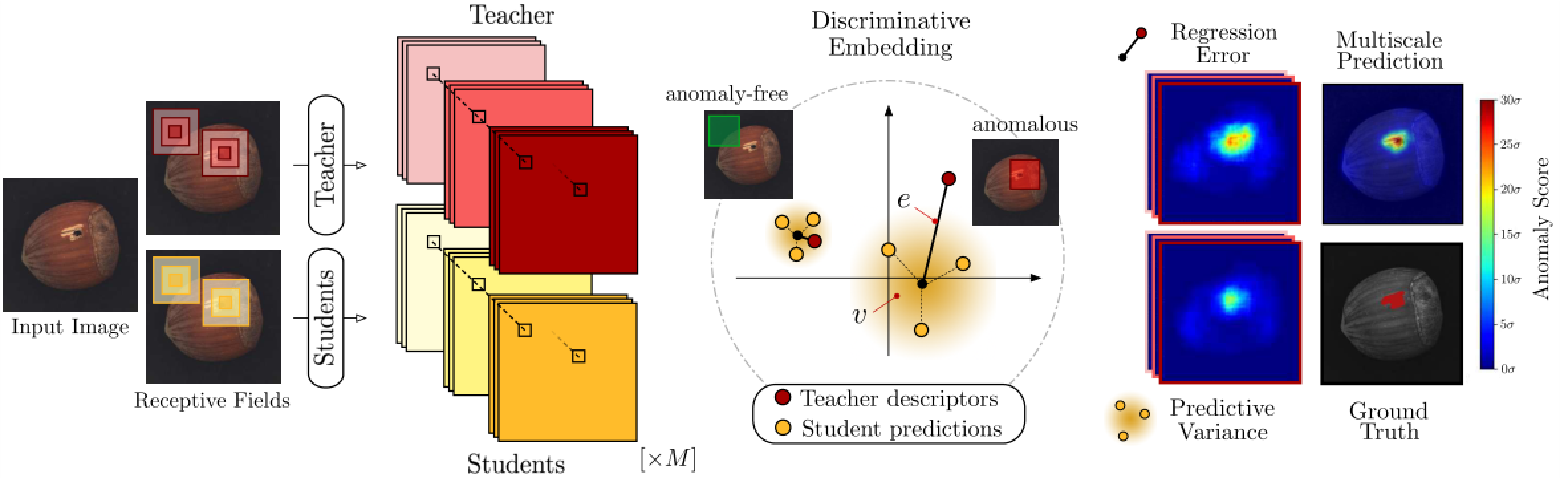

1.Student–Teacher Anomaly Detection 概览

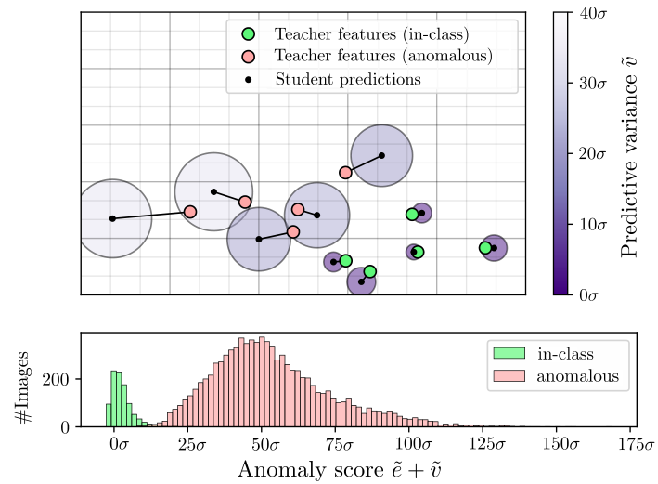

[Input images] 通过教师网络提取局部图像区域的密集特征。训练M个集成学生网络,以将教师网络的输出回归到无异常数据上。推理过程中,学生网络将在感受野覆盖的异常区域像素中产生额外增加的回归误差e和预测不确定性v。可以组合使用不同感受野生成的异常图以进行多尺度异常分割。

2.Student–Teacher Anomaly Detection 细节

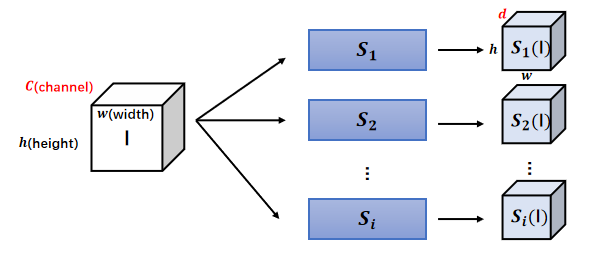

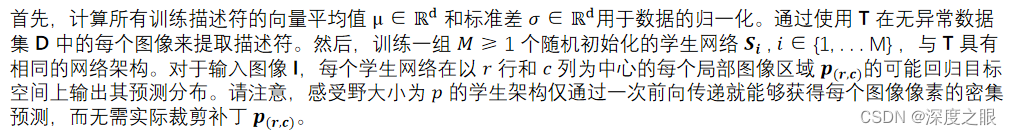

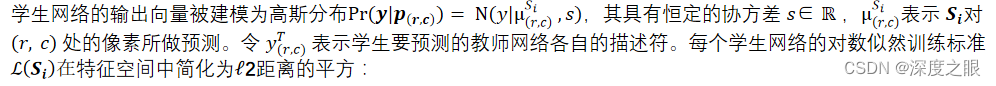

给定一个训练数据集 D = { }的无异常图像,目标是建立一个 [学生网络

] 的集合,该网络稍后可以检测测试图像 J 中的异常。这意味着它们可以为测试图的每个像素分配一个分数,表明与训练数据流形的偏离程度。为此,学生模型针对从在大型自然图像数据集上预训练过的描述性 [教师网络T] 获得的回归目标进行训练。经过训练后,可以从学生网络的回归误差和预测方差中得出每个图像像素级别的异常分数。

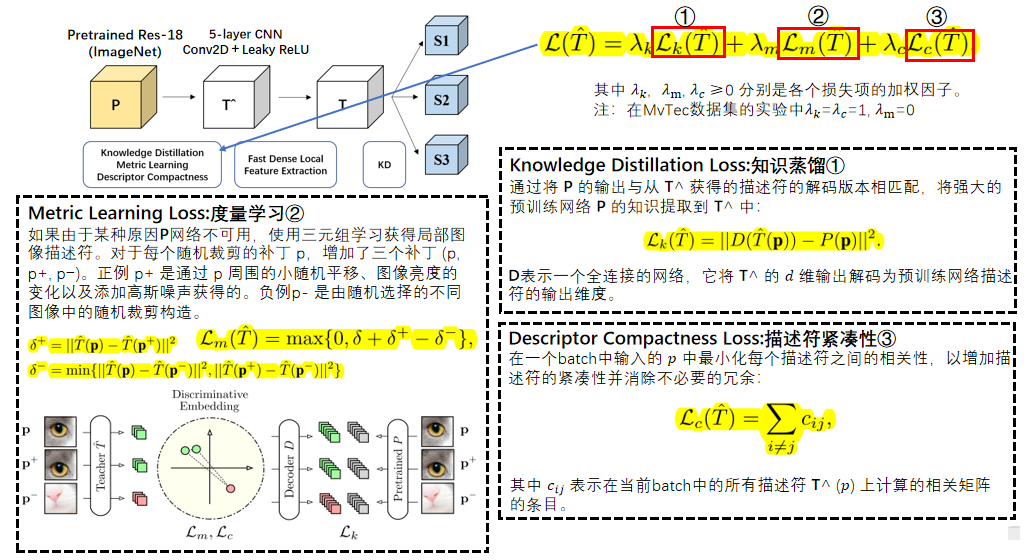

3.Learning Local Patch Descriptors 原理

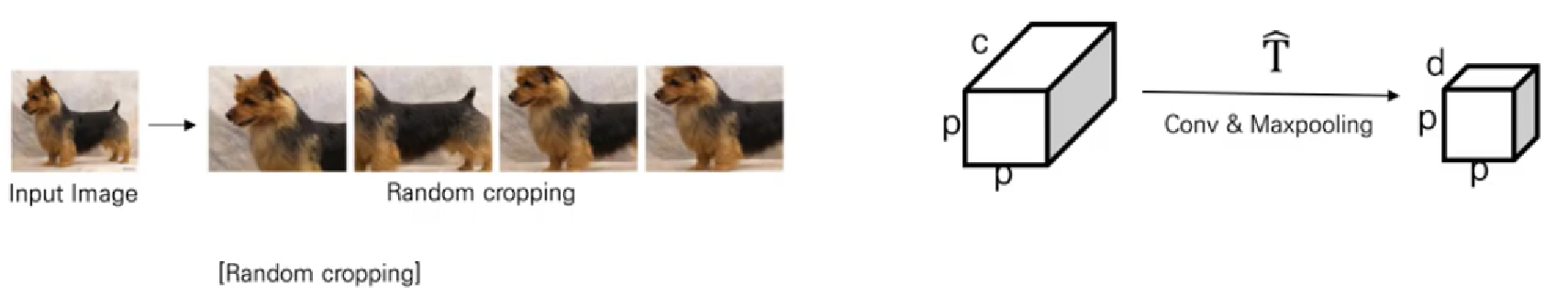

使用度量学习和知识蒸馏有效地构建描述性教师网络T :

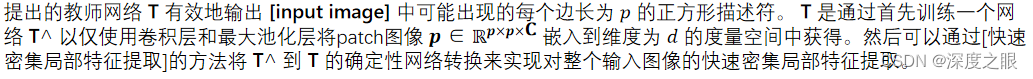

为了让 T^ 输出语义较强的描述符,我们研究了自监督的度量学习以及从具有描述性但计算效率低的预训练网络中提取知识。通过 [RandomCrop] 可以从任何图像数据集中获得大量的训练patch-p,本文中使用 ImageNet数据集。

3.Learning Local Patch Descriptors 细节

4.Ensemble of Student Networks for Deep Anomaly Detection

接下来,描述如何训练学生网络 以预测教师在无异常训练数据上的输出。最后从学生网络在推理过程中产生的预测不确定性和回归误差中得出异常分数。

其中,表示用σ值填充的对角矩阵的逆。

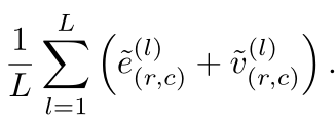

「异常分数方程:」

在每个学生网络训练收敛之后,通过对集合的预测分布进行均等的加权,能够在图像每个像素处获得混合高斯量。由此可以通过两种方法获得异常测度:

-

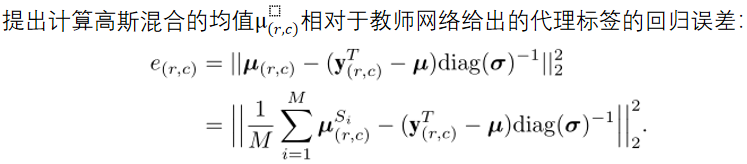

A) Regression Error(Residual error)回归误差:

[Insight:推理过程中,学生网络无法在异常区域内回归教师的输出,因为在训练过程中没有观察到相应的描述符]

-

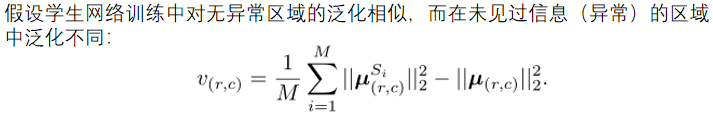

B) Student’s predictive uncertainly of the Gaussian mixture 预测不确定误差:

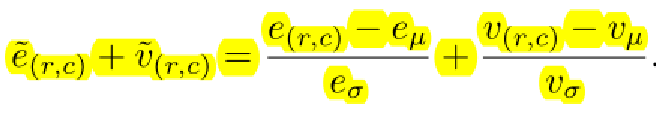

为了结合这两个分数,分别在无异常图像的验证集上计算所有和

的均值

,

和标准差

、

。通过一组无异常图像的验证集,将归一化的分数相加得到最终的异常分数:

5. Multi-Scale Anomaly Segmentation

在实际测试阶段,如果一个异常区域只覆盖了教师网络的感受野大小为 p 的一小部分,则提取的特征向量主要描述了局部图像区域的无异常特征。因此,这导致学生网络能够很好地预测描述符,异常检测性能会下降。可以通过对输入图像进行下采样来解决这个问题。然而,这会导致输出异常图的分辨率出现一定的损失。

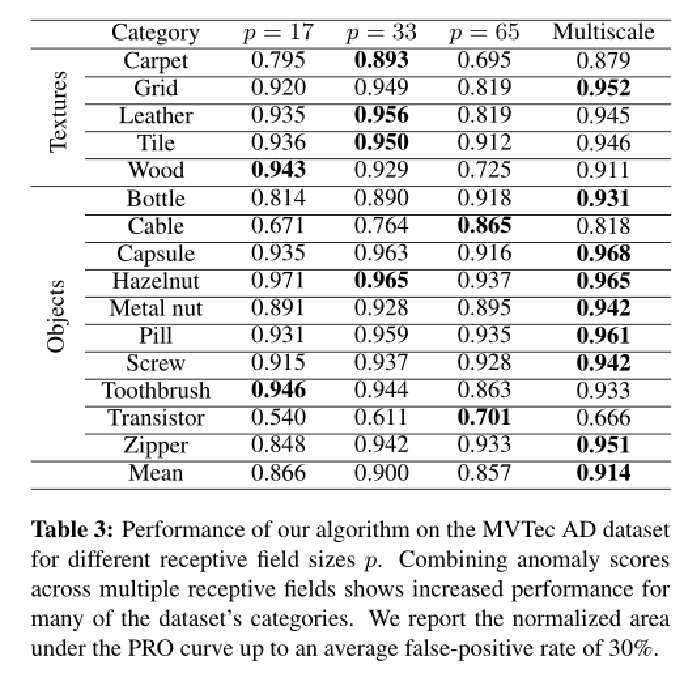

6. Experiments on MvTec Anomaly Detection Dataset

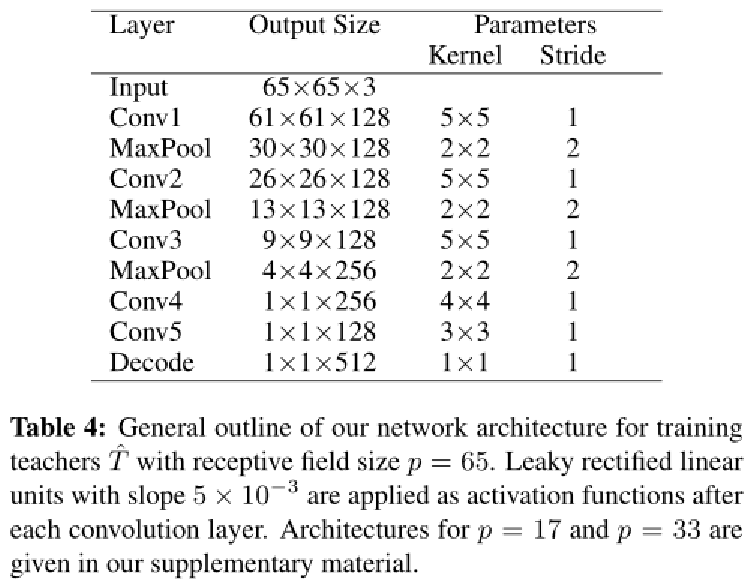

参数/网络结构选择细节:

Baseline 比较概览:

关注下方《学姐带你玩AI》???

回复“500”获取AI必读论文合集

码字不易,欢迎大家点赞评论收藏!

QT多线程的5种用法,通过使用线程解决UI主界面的耗时操作代码,防止界面卡死。...

QT多线程的5种用法,通过使用线程解决UI主界面的耗时操作代码,防止界面卡死。... U8W/U8W-Mini使用与常见问题解决

U8W/U8W-Mini使用与常见问题解决 stm32使用HAL库配置串口中断收发数据(保姆级教程)

stm32使用HAL库配置串口中断收发数据(保姆级教程) 分享几个国内免费的ChatGPT镜像网址(亲测有效)

分享几个国内免费的ChatGPT镜像网址(亲测有效) Allegro16.6差分等长设置及走线总结

Allegro16.6差分等长设置及走线总结